Deepseek 冲击波之后,怎样复盘它的得手、瞻望它的翌日?

整理 | 宛辰

剪辑 | 靖宇

2025 年开年,迎来了「中国的 ChatGPT 时刻」。

由于 DeepSeek-R1 模子能力带来的轰动,从硅谷到中国、从老东谈主到小孩、从 AI 创业者到九行八业的从业者、从小红书到抖音,都在「玩」DeepSeek。

DeepSeek 最新的「一又友圈」是百度和微信。前者即便濒临传统搜索带来的丰厚生意呈文,也接入 R1 主动变革;而从不激进的微信也荒凉地积极了一把,接入 R1 升级了微信中的「AI 搜索」

很难联想,在 ChatGPT 出身两年后,所谓「大模子窗口期已过」的时辰点上,杀出了这样一匹黑马,以通盘东谈主出东谈主预见的样式,掀起了大模子产业的桌子。当通盘东谈主都看到 DeepSeek 带来的机遇,当大厂也一反常态不再要求先作念出自研的模子时刻、而是当今就接入最佳的 DeepSeek 模子作念 AI 愚弄,2025AI 会怎样发展?

2025 年 2 月 8 日,极客公园「整夜科技谈」直播间邀请极客公园创举东谈主 & 总裁张鹏,昆仑万维 董事长兼 CEO 方汉、秘塔科技 CEO 闵可锐和清华大学交叉信息院 助理莳植 吴翼,一齐探讨了 DeepSeek 带来的冲击波以及 2025AI 愚弄还能怎样作念?

DeepSeek 文笔好、想考流程比东谈主类都有逻辑,这会成为接下来作念居品的标配动作吗?

有了 DeepSeek,蒸馏还能怎样作念?为什么蒸馏是旧例方法论,与价值不雅无关?

为什么说有了 R1,也并不虞味着 AI 愚弄更好作念了?更大的挑战才刚驱动。

DeepSeek 之前,大模子领域默许「衰老老二不开源,老三开源赚名声」轨则,但反倒是从第一天就对峙开源引颈时刻生态的 DeepSeek 赢得了六合。开源到底意味着什么?当今,是不是应该问:还有谁莫得加入开源队伍?

靠优化 AI Infra 杀青「价钱屠户」背后,莫得东谈主比 DeepSeek 更懂英伟达 CUDA,翌日,模子推理价钱还可以香到什么进程?

达到全球第二的收货后,DeepSeek,接下来会发什么?

看完这篇,你会对 2025 年接下来 AI 圈行将要发生的大事件,有更好的判断。

01 DeepSeek-R1:开源模子有史以来最佳的收货

张鹏:从你的角度,DeepSeek 此次爆火背后,最值得关注的创新点是什么?

吴翼: DeepSeek-R1 是第一个开源的,而且的确接近、达到 OpenAI o1 水平的模子,后者是一个新的推理类的范式。同期,DeepSeek 还把怎样得到 R1 这个模子的许多细节、大致的 recipe(配方)也告诉你了,在这一丝上,它亦然第一个。

带给我最大的冲击是两件事情。第一,没料到能这样快作念出来,因为从 o1 面世(2024 年 9 月 13 日),到中国的团队驱动尝试复现 o1 近似的模子,DeepSeek 的确作念这件事满打满算也就半年。在这条时刻线上,OpenAI 可能探索了一两年的时辰才作念出 o1。

第二是当这个模子拿出来的时候,没料到「哇,真的这样好」,R1 是开源、通盘东谈主都可以试。

两件事情加起来,一下子就没话说,相称有历史时刻的嗅觉,然后春节就没过好(哈哈)。

张鹏:通盘东谈主都在想考,怎样出来的,为什么不是咱们(哈哈)。你们怎样看 DeepSeek 冲击波?

闵可锐: 知谈这家公司是在 2023 年他们刚建立的时候,那时可能为了招东谈主等诉求,(DeepSeek 创举东谈主梁文锋)略略有一些对外的发声,看完会感受到这家公司身上很不一样的特点、相称转头实质的参议问题的方法。是以 DeepSeek 能在一年多的时辰作念到像当今这样火热的进程,也许有一定的不测性,然而对于他能把这件事作念好,并不虞外。

方汉: 最早知谈 DeepSeek 是在 2022 年底、2023 岁首去买卡的时候,不测得知幻方有万卡。自后防护到 DeepSeek-Coder 模子在代码类 Benchmark 上一度冲到全球第一。

再即是「推理价钱屠户」DeepSeek-V2 的推出,平直把模子推理价钱打到了那时业内平均价钱的 1/10。这里面有两项时刻印象绝顶长远,一个是 MLA(多头防护力的优化),第二个是 MTP(Multi-Token Prediction,多 token 瞻望)。

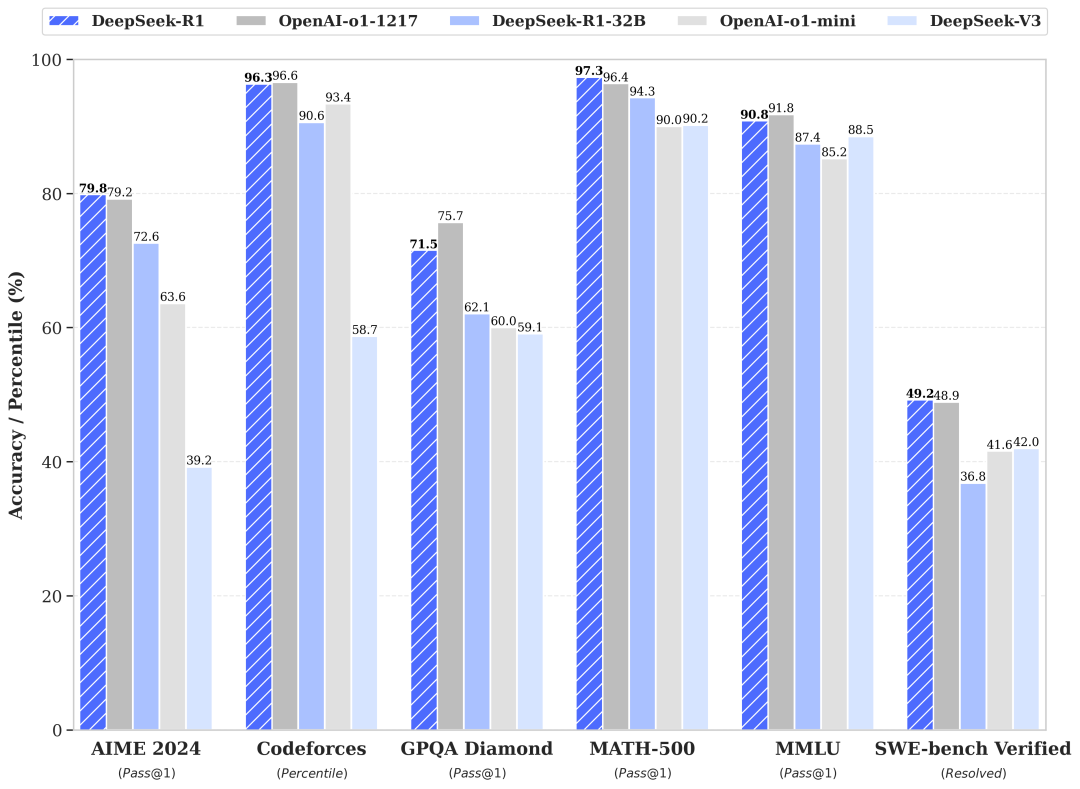

最近是 V3 和 R1 的推出。V3 是一个挺强的基模,然而它跟 Meta 的 Llama 405B、Qwen 等系列开源模子一样,前边还有两个天花板,OpenAI 的模子和 Anthropic 的 Claude。 然而 DeepSeek-R1 这一次平直能够排到第二名的位置,开源模子有史以来最佳的收货,这是让咱们最胆怯的。

DeepSeek-R1 在后熟谙阶段大界限使用了强化学习时刻,在仅有少量标注数据的情况下,极大擢升了模子推理能力。在数学、代码、天然话语推理等任务上,性能并排 OpenAI o1 郑再版。|起原:DeepSeek

张鹏:DeepSeek-R1 里的模子时刻,有哪些创新让你们印象比较长远?

方汉: 时刻角度,此次 R1 作念了许多时刻上的矫正,像 DualPipe 算法,像用 PTX 去写通信之类的,最印象长远的信托亦然训 R1-Zero 用的 GRPO 这个时刻,这是通盘这个词 R1 里最中枢的东西。

因为 OpenAI 在作念 o1 的时候,请了上百个数学博士天天解题,数据相称高质地,但他从来不对外界说怎样作念数据。全球也知谈许多公司会用 PPO,的确能把 PPO 用得绝顶好的照旧 OpenAI 和 Anthropic。国内全球在 PPO 用不好的前提下,DeepSeek 用 GRPO 的方法相称精巧,省却了 Critic Model,后者作念起来绝顶大、绝顶慢。

通过 GRPO 的方法,可以快速迭代出一批绝顶高质地的 CoT 数据,这一丝绝顶令东谈主胆怯,等于说 OpenAI 我方辛阻挠苦找东谈主用钱作念出来的数据,被咣地一下给开源了, 而且从散伙上来看,它的质地绝顶好,不逊于 OpenAI 的里面数据。这一丝长短常相称立异性的,咱们一直认为合成数据比不上东谈主的数据,然而 R1 这一次有可能标明,合成数据不比东谈主标的数据差。 这给许多东谈主带来了但愿,像欧洲、印度、韩国都合计我方也可以作念了。

闵可锐: 参议最多的照旧 R1-Zero 的时刻创新。

以前全球认为,不管是作念 SFT(有监督微调),照旧作念强化学习,都依赖大都东谈主工标注的数据,东谈主工在里面参与度相称重。比如之前传出 Meta 在数据标注上,是以亿好意思金级别的参预去换得质地相对较高的数据。然而 R1-Zero 标明其实可以大界限缩短对于东谈主工标注(数据)的依赖。

同期,R1-Zero 的败坏带来了代码能力、数学能力、推理能力的擢升。

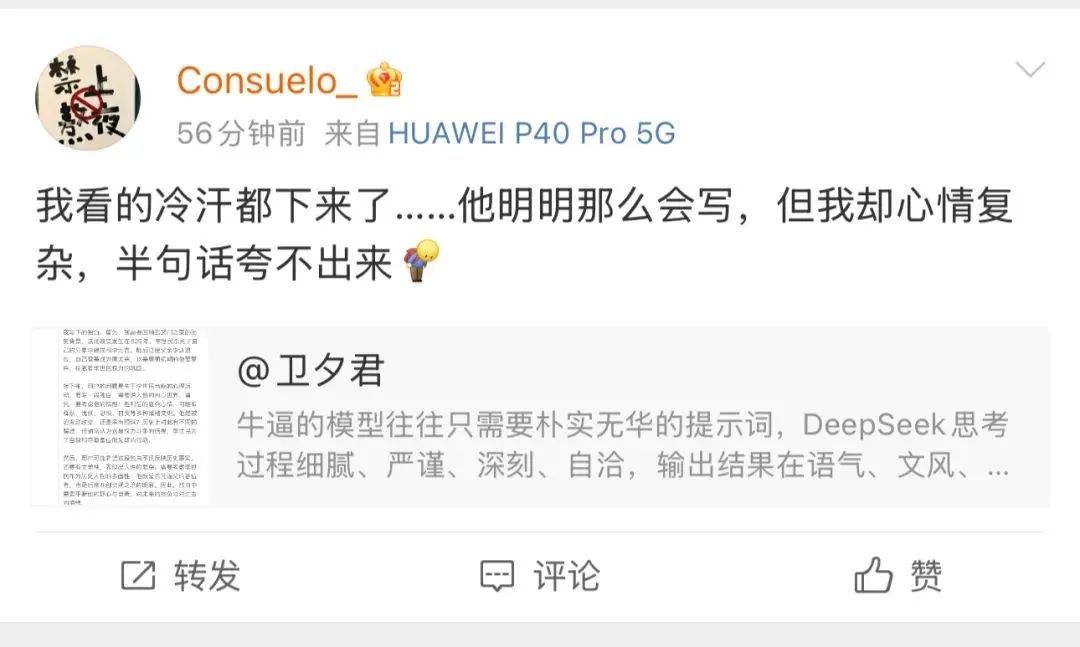

但我合计 能火到全民皆知的进程,其实不是由于它的推理能力、代码能力,照旧因为 DeepSeek 写东西(的水平)超出了 90% 的东谈主,写稿能力相称杰出, 这件事轰动到了全球。

02 DeepSeek 文笔好,是因为莫得好好作念居品?

张鹏:许多网友都说被 R1 的文笔惊艳到了,至少公众感情是这样被烽火的,不管是在中国照旧国外。就连AI创业者也会嗟叹,以前用 o1 给东谈主的嗅觉是多了一个感性的职工,今天用 R1 却嗅觉成为了他的东谈主生导师,果然能带来许多启发。所谓的模子文笔好,时刻上是怎样杀青的?

吴翼: 浅近说,文笔绝顶好(的原因)即是 DeepSeek 莫得好好作念居品(哈哈)。

如果用 ChatGPT 写,凡俗会讲著作 GPT 味绝顶重。为什么呢?因为 ChatGPT 在安全、对皆(alignment)上作念得相称猛。这样就会导致,比如当东谈主跟 AI 一齐玩「狼东谈主杀」时,你绝顶容易看出来哪个是 GPT。因为东谈主类玩家会平直说,「这个东谈主一定是个坏东谈主」,但 GPT 会说,「我合计这个东谈主好像怎样样,咱们应该怎样感性分析……」讲许多啰里八嗦的妄言。这即是它「对皆」作念得绝顶好的体现,它但愿这个东西不要冒犯到东谈主,但愿居品化作念得好。

但 DeepSeek 显着莫得好好作念这件事情,是以大模子本来的这些信口胡言的想法就被你看到了,而 OpenAI 为了作念安全性,为了作念所谓的「价值不雅对皆」,反而是把模子的许多能力收起来。

第二,如果仔细地去看 R1 的时刻求教,它其实分了两步,先用强化学习作念出了一版推理模子,但莫得平直给你用这个推理模子,而是背面有一个合并模子的流程,临了是竣工版的 R1 模子有一些泛化能力。

张开讲,因为在代码、数学这种特定任务上作念强化学习熟谙出来的推理模子 R1-Zero,笔墨上信托会差一些,是以 R1-Zero 又跟原本的基模 V3 用 SFT 这种近似于蒸馏或者合并模子的流程,临了合并出了带有泛化能力的模子 R1。这也证明 V3 这个模子确乎相称好, 如果 V3 比较差的,临了合并出来你也看不到那么多奇想妙想。换句话说,强化学习很迫切,基模也很迫切。

张鹏:这个视角蛮专门想,反而是过度对皆,会让它的脑洞、联想力或者一些 hallucination(幻觉)被压制了。

吴翼: 对,创意其实是 hallucination。

作家卫夕向 DeepSeek 发问 「玄武门之变收尾确本日,李世民在深宵写下一段独白,你合计他会写什么?」 ,网友为 DeepSeek 输出的谜底而感到齰舌。|截图起原:微博

张鹏:可锐,你怎样看它的笔墨抒发很好?背后有什么原因和庄重?

闵可锐: 我估计可能有三个原因,一是刚才提到的 DeepSeek 莫得试图把许多偏个性化的一些抒发给阉割掉。你会发现许多 GPT 的恢复是「端水型的」「安全型的」,但其实比较 boring 的恢复。是以 DeepSeek 一定莫得在安全性方面作念激进的动作,模子输出的抒发上相对比较解放。

第二个估计,许多东谈主合计 R1 的强化学习自己增多了它的写稿能力,但我对这件事是存疑。我听到的一个信息是,之是以有比较好的抒发, 背后是有比较资深的、近似于北大汉文系的东谈主在襄理在写数据。东谈主的解放抒发和高质地的数据看成对模子恢复的一个指引,来达到好的恶果。 我会合计应该是 SFT 这个部分的数据作念得相称好。

第三,R1 以及 V3 的模子如果和行业同类模子比较,它其实把界限差未几涨了 10 倍,差未几从一个几十 G 的界限涨到了几百 G。这个界限下它能够储存的信息容量差未几比上一代 Qwen 涨了十倍,这让它在许多比较详尽的抒发上能够有更好的复原。也即是说 它的压缩率其实无须作念得那么高,能够记取更多东西,包括像诗词、或者通达式的问题上。

总结来说,更大的脑容量、能手撰写的体裁性数据作指引和对皆,而且缩短了严格的安全对皆(设施),可能是这三点加起来得到了 DeepSeek 的优好意思长远的抒发。

张鹏:一些在硅谷的华东谈主 AI 研究员也说,可能以前国外的大模子对于高质地汉文数据莫得绝顶较真过,但 DeepSeek 较真了。方汉你怎样看「全球说 DeepSeek 文笔好」?

方汉: 固然我学的是理科,但我高考作文是满分,是以对古文比较熟,我绝顶可爱让大模子写古诗词。在这件事上,当今写的最佳的模子施行上是 Claude,也即是说 Claude 的文华比 ChatGPT 要好许多。 我合计照旧数据的原因,全球公认 Anthropic 对数据的品位最高,数据作念得最佳,他们的数据团队界限在语文和写稿方面相称强,我猜 DeepSeek 亦然近似。

DeepSeek 里面可能有一套方法,可以从现存的数据里面生成质地相称高的语文数据,这是我的猜想。因为请大都顶尖团队比如北大汉文系标数据,DeepSeek 恐怕竞争得过大厂,(靠东谈主工标注数目和质地取胜)逻辑上讲欠亨。 DeepSee k 在不要东谈骨侵略的情况下,可以用 GRPO 可以生成数学和编程的 CoT 数据,那这些方法能不可用在语文上去生成高质地的语文数据,这是我更信托的一个推断。

另外,咱们在作念推理模子的时候有个叫 temperature(温度)的参数,如果把这个参数值设得高,模子就驱动瞎掰八谈、绝顶有创意,但也很容易崩。可能因为 R1 的推理能力很强,哪怕把 temperature 加得比一般模子高,亦然比较活跃且退却易崩。

03「被 DeepSeek 的想考流程轰动到了」

张鹏:除了文笔好,许多用户也被 DeepSeek 想考流程的透明和看法的逻辑打动,R1 是第一家展示想考流程的模子吗?

吴翼: 竣工想维链的透明展示,确乎是 DeepSeek 第一个作念出来的,但 R1 不是第一次,第一次的确公通达盘想维链的模子是客岁 11 月 20 日发布的 DeepSeek-R1-Lite。

自后 Gemini 跟进了,也公开了想维链,Gemini 的 Flash thinking 的想维链质地也可以。

其实客岁 9 月 OpenAI 发布的 o1 也给了这样的中间形状,仅仅它不给你看想维链的竣工版,就给你一个总结版。从时刻视角上,藏没藏想维链差挺多的。不外总结版的想维链固然不竣工,但也挺有价值的,许多东谈主发现即使是「扒」总结版想维链数据,也能对模子有许多擢升。

图片起原:视觉中国

张鹏:你合计 OpenAI 为什么不给全球公开想维链?

吴翼: 高质地想维链对于模子的能力擢升、以及激勉模子让它在第二阶段强化学习熟谙时能有很好的推剪发扬、连续用强化学习作念 Scaling Law 是很迫切的。是以 OpenAI 应该在这件事情上花了一些力气,他知谈如的确的把想维链给你去 distill(蒸馏),你很快就能作念出来,他即是不让你「抄」。

最近李飞飞淳厚团队作念的、被炒得很热的 S1,50 好意思金能够让你看到 test-time-in-scaling 的恶果,也证明了这个道理。它只输了 1000 条 Gemini 的长想维链数据,就能让模子有比较大的推剪发扬上的质变,天然它恶果还比较一般,50 好意思金不可能真的把 R1 复现。是以高质地的长想维链数据是迫切的,这亦然 OpenAI 不肯意给你看的原因。

方汉: 我合计 OpenAI 即是想保守隐痛,OpenAI 一直认为想维链数据是它最值钱的数据,是以很早就出了一个 term sheet(要求),你若是敢 jail break(逃狱)问他 CoT 的问题,他会封你的账号。R1 发布之后,OpenAI 也把 o3-mini 的想维链输出了,但这里是总结版的想维链,散伙又被网友骂了,然后当今又正在把总结再去掉。

天然全球莫得料到的是 DeepSeek 说,要不我试一下,我也不要中间这个形状,平直给你强化学习行不行?很万古辰全球都合计中间需要搞一步 SFT,散伙 DeepSeek 出来跟你说,咱们试了一下,好像不需要也行。

张鹏:因为莫得东谈主作念出来过,或者莫得东谈主按这个样式作念出来过。

吴翼: 即是 对面有一家告诉你这个东西特迫切,「配头当军」,我家一定莫得黄金,你千万别来。那全球都会往这上头花许多元气心灵想,临了 DeepSeek 试出来说,你看你没这玩意也行,哈哈哈,或者说有比较低廉的方法能绕以前。

张鹏:秘塔科技也在第一时辰与 DeepSeek-R1 合作作念了研究的功能,想考流程的可视化。可锐,从用户的角度,你怎样看这件事带来的影响?展示透明的想维链自己,是不是一种用户价值拜托?

闵可锐: 我会合计想维链,不管是总结版也好,照旧像 R1 给到一个相对竣工的想维链,最早的起点可能是通过形状和形状之间的推导,提高散伙的准确率。

但把它展示出来,我会认为最早是因为中间的恭候时长实在太长了。如果 让用户在这继续断地比如像看沙漏一样(等时辰),用户体验长短常厄运的。是以既然有一个中间的推导流程,索性把推导流程夸耀给用户,然而这似乎带来了一个相称不测的平正。

许多东谈主反而专门去看想维链,「诶,这个模子怎样想考的?它怎样从不同角度去商酌我提的问题」,这对我来说是略略有点不测的。我不雅察到许多东谈主其实还挺可爱看 R1 的想维链,因为模子把想维链写得像是一个内心独白一样。

就像有东谈主问它说,「诶,我有一个一又友怎样怎样样」,然后这个想维链里说,「这个大致率是用户我方想问这个问题」,即是有一种果然被 AI 识破的体验。 我合计这可能亦然出乎创造者意象的恶果。

DeepSeek 推测,用户说是别东谈主的发问,很可能是用户我方的发问。|截图起原:DeepSeek App

张鹏:方汉,你怎样评价此次 R1 展示的透明的想维链?

方汉: 从纯时刻的角度,看想维链可以矫正你的 prompt。但对于绝大部分用户,不会这样用想维链。

对于用户来说最可怕的体验是,看到 R1 想维链这样严实的推理流程,有点像咱们小时候看卡耐基得手学、有点像听一些绝顶牛的东谈主把他想维样式给你讲一遍,你是会很轰动的。

当今,你目睹了 AI 用一个贤达东谈主、得手学的方法给你推导一个问题,通盘东谈主心里都会心生艳羡,「这个 AI 真贤达,接近东谈主类智能呢」。我合计这 对居品的践诺来说,是一个决定性的情绪默示。

张鹏:像这样一个让全球合计很轰动的想维链,是怎样作念出来的?

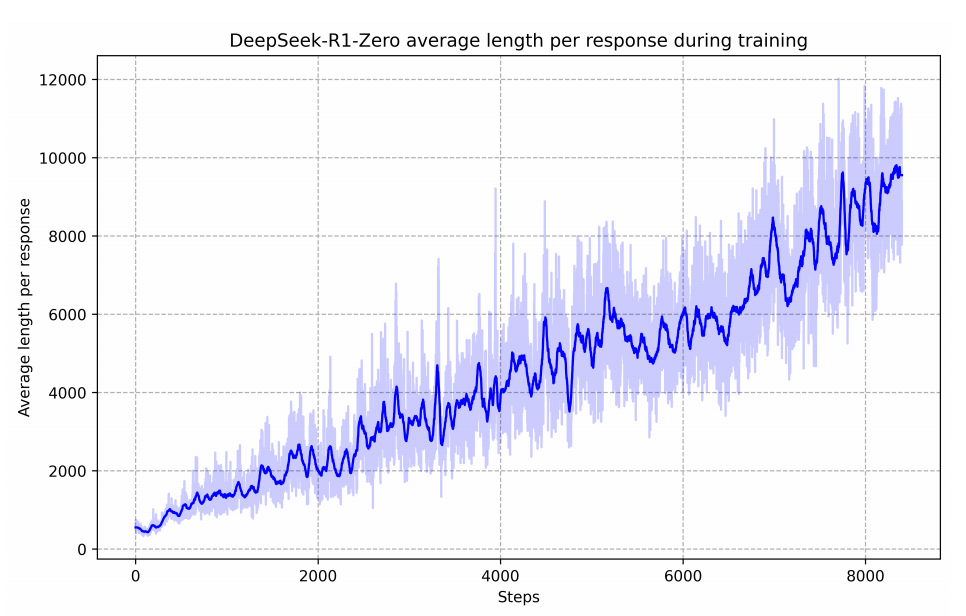

吴翼: 当先 想维链是表露出来的,不是东谈主标注出来的,东谈主标不出这样的想维链。 如果你仔细去看 DeepSeek 产生的想维链,许多亦然错的,或者说莫得任何道理,再比如之前 OpenAI 的想维链里还出现过汉文。这些都证明,是由强化学习的 Scaling Law 让想维链表露出来的。

是以判断一个模子是不是推理模子,只消看它敢不敢放出一个熟谙弧线——模子输出长度随着强化学习的熟谙时辰在不息变长。如果能看到这个不息变长的弧线,基本上可以认为这个熟谙是得手的;如果看到它的长度变短了,那应该就失败了,即使它的正确率或者表当今擢升,亦然失败的。也即是说,这个长度是表露的,临了推理模子呈现出来的极强的反想,是泛化的散伙,是表露的散伙,而不是东谈主标的。

DeepSeek-R1-Zero 的性能轨迹,通盘这个词强化学习流程中踏实且持续擢升。|截图起原:DeekSeek-R1 时刻求教

第二, 需不需要一个东西去激勉这个模子的想维链?基本上是需要的。 OpenAI 在熟谙模子的时候应该照旧用了一部分这样的数据去激勉基座模子的想维链能力,然后再上强化学习的。

然而我合计比较神奇的一件事情是,如果你仔细去看 DeepSeek 的时刻求教,你会发现即使用比如 Qwen-32B、Qwen-70B,基座模子在莫得任何强化学习熟谙的情况下,通过 prompt 的治愈也可以看到它的一些反想流程。也即是说,基模从某种进程上照旧有一些自激勉能力。

是以这亦然 DeepSeek 可以从基模平直进行强化学习的一个迫切原因,基模在强化学习驱动的时候就存在一定的反想、想维链能力,然后再通过强化学习 Scaling Law 的样式,把反想能力放大,表露出来临了的 R1 模子。天然也证明 DeepSeek-V3 这个基座模子作念得很好,导致它一驱动就有了自我激勉的能力。

如果这个基座模子,比如说在数学上有一些基座模子有一些反想能力,但在语文上,比如说真的统统莫得「诶,等等,我说错了我再想想」这样的发扬。再怎样强化学习?也不会表露出反想能力,如果基座模子很差,莫得准备好被激勉的话,那也没用。

张鹏:如果莫得「等等,我可能想得不对」近似的推理反想能力,再怎样上强化学习,也不会出现想维链的线性发展。

吴翼: 对, 强化学习跟预熟谙是乘法的关系: 预熟谙的 scaling 是第一个整个,强化学习后熟谙是第二个整个,这两个是乘起来的关系。

如果一个维度是 0,怎样乘也没用。但这里哪怕是个 0.01 也没问题,背面帮你乘上去,是以这也证明 V3 的基模真的相称好,是以它能让你作念出一些事情来。时刻求教里也作念了实验,比如说是 7B 的小模子,怎样强化学习也没用,还不如蒸馏。是以强化学习和基模有这样的一个关系。

张鹏:怎样意会强化学习在 R1 和 R1-Zero 体现出的恶果?

方汉: 打个不太稳健的比喻来类比意会,让一个小孩学乒乓球,先让他看通盘高手打乒乓球的视频,但他看完毕之后仍然不会打。

这时候有两个方法,一是请国度队队员比如马龙来教他,但绝大多数家庭请不起国度队。怎样办呢?这时候请不起国度队的家庭就想了个宗旨,让东谈主对着一个洞去打球,打不中就「电」你一下。赏罚机制下,终于这个小孩成了一个绝世高手,然而他这时候还不太懂乒乓球的章程,发球也不设施等等。这时候终于又请了一个熟谙,告诉小孩得按照什么样的章程打球,让他把章程学会,学会了就出去「大杀四方」,这个逻辑大致是这样。

这里其实有一个问题,刚才全球也聊到了, 当今不知谈 V3 这个基座模子看没看过高质地的 CoT 数据?然而它自后的激勉作念得相称得手。 我合计这给了通盘「穷东谈主」一个念想,我靠我方「电」我方,也能把我方「电」成高手。这样的话,许多欧洲、印度的公司也可以驱动熟谙这种高质地模子了。

张鹏:时刻圈对于 R1-Zero 的参议是大于 R1 自己的。

闵可锐: R1-Zero 的这件事,更像是一个范式的变化。Zero 这个名字就会让全球容易瞎料到 2017 年谷歌 DeepMind 出身的 AlphaZero 这个名字,如出一辙。

DeepMind 先让机器学习东谈主类怎样下围棋,上升到统统不告诉机器东谈主类下围棋的方法、只告诉它章程——下到什么场所你就取得特脱手、下到什么场所你失败,就能够把模子熟谙到高出东谈主的水准。这件事翻开了全球的联想力,让它自我博弈、自我学习,有可能出现高出东谈主类最强棋手的能力。

一定进程上,R1-Zero 带来了这样一个类比和瞎想。天然两者不统援手样,AlphaZero 鄙人围棋上作念强化学习的时候莫得任何东谈主类教养的参与。但 R1 可能照旧受到了基模 V3 的激勉,后者是一个学习了全互联网东谈主类常识的基座模子,R1 表露出来一些反想、自我纠错的能力,实质上照旧因为全互联网数据里存在东谈主类反想,近似「诶,这个地方等等,我好像作念得不对,让我来矫正一下」的一些基础数据,哪怕比较稀少,然而仍然被 V3 给捕捉到了。在这个基础之上,用强化学习的能力把它进一步放大,达到一个更好的一个恶果。

04「蒸馏」是业内常用的方法

张鹏:R1 出来之后,有许多参议说翌日是不是可以通过蒸馏,让端侧的模子能力也得到比较大的加强?有了更好的模子,再加上蒸馏这件事,对创业者作念居品或者模子有什么平正?

吴翼: 分三件事来讲,一个是蒸馏,第二件事情是端侧模子,第三是垂类愚弄。

蒸馏的流程是指,你问一个问题,让淳厚说谜底,你把谜底记下来,你问 100 万次,就差未几学会了。就像熟读唐诗三百首,不会作念诗也会吟。

蒸馏确乎是灵验的,DeepSeek 在时刻求教里也标明, 如果你有一个小的模子比如 7B 以下的模子,无须去作念强化学习或者其他,有一个好的、大的淳厚模子用,平直蒸馏想维链数据是最佳的,比平直跑强化学习恶果好,也最高效的。 是以有一个模子统统公开、可以蒸馏,对许多作念居品或者作念个性化模子熟谙的公司来说,相称相称利好。

而且不光对小模子灵验,对于大的公司来说,蒸馏也相称迫切。比如 DeepSeek-R1 是 671B,许多厂商可能用不起来,或者很难高效地用起来。那么一个公司作念模子的团队如果能把 671B 的模子,作念到比如说 100B 的模子上、带来相似的恶果,这会给资本以及愚弄带来更大的可能性,这里是需要蒸馏的,我方也可以蒸馏我方,不丢东谈主。而且许多东谈主认为 OpenAI 也作念了蒸馏,是以 OpenAI 上线的模子都很小,资本可以控得很低,很大的糊涂量作念得很高效。

第二件事,端侧模子。咱们是不是需要一个竣工的端侧模子?我其实合计不一定。

我在端侧有一个比如 1B 的模子,云表还有一个 500B 的模子,这两个东西可以配合。我我方是作念多智能体强化学习的,我合计一个最意思的多智能体系统的问题是: 当你真的有两个能力不一样的模子,比如说 500B 的模子和 1B 的模子,它们之间应该怎样样阐述出一个 1B 的遵守、同期 500B 的推理能力?

当今全球研究多智能体系统频频都是在端侧用不同的模子、不同的 prompt 通过夸耀出的不同偏好和行动模式来组合,这件事情其实没什么太大的真谛,因为就像 OpenAI 的 Operator 模子或者 DeepSeek-R1 出来,你会发现一个富足强的推理模子,可以作念到一个模子干通盘的事情。

当真的有云表和端侧的模子可以配合的时候,多智能体系统就会很不一样。

第三件事情是垂类愚弄,我合计 这个期间对于作念垂类的愚弄或者叫居品,要求要比互联网期间高许多。

因为时刻迭代太快了,不光要洞悉需求,你很怕阿谁需求,因为来了更好的模子之后,通盘这个词需求的模式变了。因为从 ChatGPT 和 DeepSeek 上你可以不雅察到,黄金投资许多新的被知足的需求,并不是他们料到的,而是模子的智力擢升之后,东谈主的行动模式也发生了变化,模子的表露带来了东谈主类行动的变化、带来东谈主的需求的变化。是以作念居品也不可抓某个需求不放,而要在阿谁需求的左近一直打圈。

是以可能得去想,作念垂类愚弄的确的壁垒是什么?比如数据、渠谈信托是一个壁垒,生意模式可能亦然一个壁垒,但我合计需求自己不组成壁垒。

同期作念垂类愚弄,你还得对模子的时刻有预判的能力,三个月后它会变成什么样?半年后怎样样?下一代模子可能会怎样样?因为如果在时刻快速迭代的时候,花了太多的元气心灵和太多的钱,但可能半年之后许多事情又都不一样了,是以得相称相称预防肠去用钱。

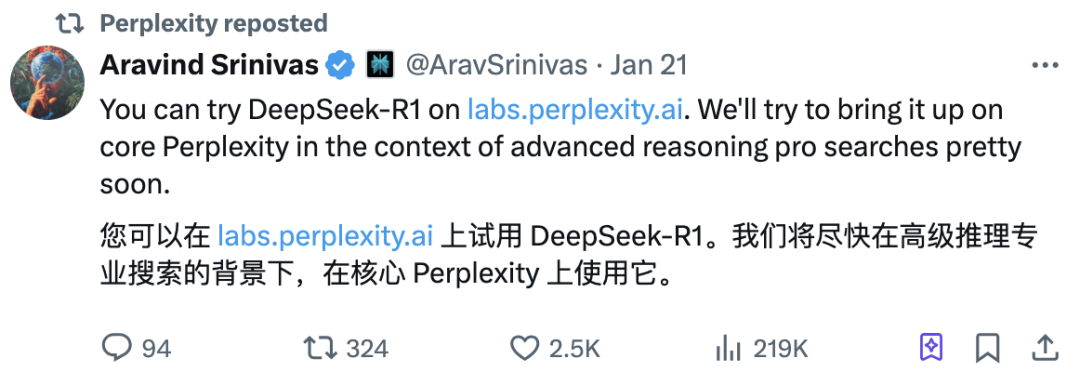

Perplexity CEO Aravind Srinivas 第一时辰官宣 Perplexity 接入了 R1 进行居品升级和进一步探索。|截图起原:X.com

张鹏:东谈主对 AI 的需求会随着 AI 能力的成长,东谈主也会篡改行动。可锐,你合计这个 AI 搜索算不算垂类?垂类居品要怎样演进、怎样构建我方的阶梯图?

闵可锐: 我合计在一个时刻演进比较快、变化比较剧烈的时期,对于时刻有相对比较深入的意会,一定是对你作念居品、对翌日的预判,有众多的匡助。

固然外界大多数东谈主对秘塔的印象,好像是一个比较贞洁的居品公司,然而咱们其实其实照旧作念过几百轮预熟谙了,在咱们有限的几十张卡上,也不雅测到许多比较专门想的适意。

是以咱们对于许多,比如哪一代模子可能能够作念什么?哪一些适意背后代表什么?不是把模子当黑箱来对待的,在对模子时刻有一定意会后,握住问题的居品视角也会不一样,比如许多东谈主会合计当今 R1 的推理资本照旧相称低了。但咱们防护到,其实在 DeepSeek 还莫得开源的部分里,有一个是 serving 的模子。

serving 的这部分固然最近有许多比如云厂商、算力中心的跟进,比如以和 DeepSeek 调换的价钱,以至更低的价钱对外提供处事。然而我可以负包袱地说,当今每一个小于等于 DeepSeek 价钱提供处事的云厂商都是在亏钱。 也许 DeepSeek 是没亏钱,但他们当今一定在亏钱, 因为当今 serving 框架其实还莫得在 MoE 架构上作念好准备,因为原本全球作念了很万古辰是在繁茂模子上作念了许多积蓄。是以当今在谈的「资本照旧降下来了」,其实是更像是一个表面值。居品司理我方去作念部署,我方去作念 serving,很有可能很快会发现这个资本和他的预期有众多互异。

对,是以这里面其实有许多 knowledge,照旧要在比较一线有富足的详尽的了解,你能作念出判断。它远远莫得到说这个照旧是一个设施化的一个器具,按绿色按钮就出来什么,按蓝色按钮能出来什么?是以我合计当今作念居品确乎得同期意会用户和意会时刻,才有比较好的竞争力。

张鹏:居品司理也照旧得把 AI 这件事多摸明晰点,以居品的能力去学习一下模子的时刻,有能让模子变白盒的意会和探索能力。

05 更好的模子,并不虞味着 AI 愚弄更好作念了

张鹏:DeepSeek 的这一波冲击波之后,从秘塔的视角,有哪些AI愚弄上值得探索的新场所?

闵可锐: 率直来讲,我合计当今还莫得到酿成相称明确的场所、逻辑的时辰节点。

但比较原本可能巨头玩家把更好的基模掌捏在我方手上,DeepSeek 开源更好的基座模子,一定进程上弱化了基座模子给偏愚弄层带来的影响,在模子层面把全球拉到了褪色个起跑线的水位,但这并不虞味着竞争会变得更小,反而可能会变得更强烈的景况。

在一个更好的推理模子基础上,确乎有契机作念出更惊艳的一些居品。谁能够靠近用户,把用户原本有然而未被知足的需求作念得更好,率先把这样的居品场所、居品能力杀青、开释出来让更多的东谈主用,也会有契机更高遵守地拿到更多的用户。

1 月 20 号 R1 发布以来,咱们在里面照旧测试过几轮(集成 DeepSeek 模子的功能)了,有一些咱们原本想要去杀青、然而不太得手、不值得对外开释的一些功能,看起来照旧可以 ready 到给全球提供可使用、且好用的居品功能。咱们很快会有一些新的功能上线,不会让全球等太久的。

秘塔 AI 搜索,率先接入 DeepSeek-R1 模子升级居品能力。|截图起原:秘塔搜索

张鹏:为什么说有了更好的模子,并不虞味着居品更好作念了?

闵可锐: GPT-4 出来了以后,能作念成愚弄的概率会权臣更高吗?R1 出来以后比 GPT-4 更高吗?都不是。因为模子能力的擢升,其实是拉高了通盘东谈主的基线。原本通盘东谈主只可作念到 60 分的时候,你能作念到 70 分,你的居品可能更受接待。但当通盘东谈主都被拉高到了 70 分的 baseline,你必须得作念到 80 分。

是以这一代创业者作念 AI 愚弄落地开发,要有一个情绪预期,可能原本你作念到的东西,当今能够平直被比如说 R1 的推理能力所掩盖掉,那你就要在这之上寻找新的可能性,才能成为被全球给与的居品。

从作念愚弄的角度来讲,更好的模子是不是代表了愚弄更好作念一些?咱们以前有在作念居品研发、落地、模子上,可能有小十年的教养,我一直的感受是,全球在这件事情上的判断过于乐不雅。

张鹏:方汉,你怎样看它对于 AI 产业站在全球视角比较信托接下来可能带来的影响、冲击和变化是什么?

方汉: 全球都说大模子的下一场是 agent,但如果是多 agent 合作的情况,只消有一个 agent 拉胯,临了质地就很差。当今 R1 保证了 agent 智能的下限比较高,许多以前完不成的、比较长、比较复杂的任务,有可能很快就会被握住。 比如 AI 编程,原本只可写单个函数,以至只可写一个文献,当今有了 R1 这样绝顶强的模子,是不是可以平直把通盘这个词工程生成出来,而且交叉地修改、debug?这样就的确成为一些可用的坐蓐力。

对于具体的居品,我合计通盘跟 agent 研究的新的居品模式会快速表露,而且由于模子是开源的、资本还绝顶低,许多居品也驱动看到了盈利的晨曦,因为推理资本下落了,而且能力还上升了。

另外,R1 在数学跟编程任务上发扬最佳,因为数学和编程是东谈主类用标志来固化想维的两个最权臣的领域。相应地,还有科学,比如说像 AlphaFold 作念的是卵白质折叠瞻望。 我认为跟标志化体式研究的、数据比较强的领域,都会带来绝顶大的遵守改善。

张鹏:昆仑万维的居品线会更丰富,这里有莫得一些比较具象的想考?经过岁首这一波冲击之后,在AI愚弄上有什么新的启发?

方汉: DeepSeek 不是第一个开源的,但它是开源的模子里面质地最佳、最接近 OpenAI 的水平的,这是它出圈的根底原因,这给 AI 愚弄带来一系列影响。

当先他把一个很高质地的模子的推理资本打低之后,给生意模式带来了更多的可能性, 免费类的AI愚弄会安宁出现。

第二,缩短 AI 愚弄的门槛是要道。全球能够写好 prompt 东谈主数不会高出 1000 万,是以怎样缩短 AI 愚弄的门槛相称要道。举个例子,最近谷歌 NotebookLM 会爆火,即是因为它极地面缩短了愚弄门槛,无须写 prompt,把 PDF 拖进去,按一个按钮就给你生成播客了。

第三,云筹谋期间,有一个词叫云原生,是指一些在云筹谋出现之后才表露出的云原生公司,这些公司统统是轻钞票,通盘处事都跑在云上。我合计 AI 期间的愚弄也会有近似变化,当今 AI 原生的居品司理其实还未几,大部分东谈主都还在用互联网和转移互联网的想路来作念 AI 愚弄。这是一个痛点,全球都还在摸索。但接下来,居品司理应衰老的 AI 公司会越来越多,AI 原生的居品策画也会越来越多。

临了,许多公司当今作念了遵守类的 AI 愚弄,然而从互联网跟转移互联网的教养来看,遵守居品的增速一定比不外文娱居品,东谈主类都是可爱呼乐至死,而 文娱居品其实并不一定需要绝顶强的 AGI,然而需要绝顶强的AIGC,是以我认为文娱居品的发展速率接下来会远远高出 ToB 的遵守居品。

张鹏:遵守型的器具可能是东谈主类的一部分需求,东谈主类无穷的需求是文娱,你合计在文娱这件事上 2025 年有什么样的东西值得看?在文娱方面会出现富足让东谈主欢叫的 killer APP 吗?

方汉: 东谈主类最可爱、资本最低、门槛最低的文娱样式是视频,咱们认为视频生成领域一定会表露出最大的 killer APP,仅仅不知谈是传统的渠谈为王、照旧新的视频制作平台为王。

全球都知谈短视频席卷全球,短剧当今是第二波,也要驱动席卷全球,当今就算短视频的资本很低,然而拍一部短剧也要 100 万东谈主民币,是以当今中国每年只可产三四千部短剧。如果咱们能够把单部短剧的资本达到 2000 块钱,那么全天下每年可能会有几百万部短剧的产出,这会对通盘这个词业界带来相称大的冲击。

打个比喻,我莫得学过音乐、也五音不全,当今用咱们的音乐生成大模子,我可以作念许多首歌。同期在资本上,举个例子,咱们原本作念游戏业务的时候,订购一首音乐平均 5 万块钱摆布,当今音乐模子推理资本可能只消几分钱,这即是资本以及门槛的缩短。

当一个东西的坐蓐门槛以及资本权臣缩短,AI内容就会像抖音的短视频作家那样,因为手机录像头和 4G 的出现,坐蓐出大都短视频内容。 但我合计 2025 年还可能还莫得到时辰点。当今的视频生成模子固然照旧相称强了,然而还莫得到能够取代竣工的影视产业链的地步。

客岁底,昆仑万维在好意思国上线 AI 短剧平台 SkyReels,在全球 AI 文娱市集作念出进一步探索。|起原:昆仑万维

张鹏:本年的视频生成领域还会像 2024 年一样快速迭代吗?

方汉: 对。2023 年春晚照旧有 AIGC 的视频出现了,但那时候还比较原始,当今比如字节最新发的 OmniHuman 视频质地就相称好了,全球都在速即演进。

而且全球也不要迷信 OpenAI,Sora 照旧被第三方的、闭源的、开源的模子迅速追上,也即是说 OpenAI 在图像生成和视频生成领域起了个大早,赶了个晚集,当今无论开源照旧闭源,都有跟 Sora 比起来有很强的竞争力的视频生成模子。而且开源生成模子有更好的生态,对长尾需求的知足也会更好,最终基于此的生意模式也会最多。

张鹏:你怎样看 chatbot(聊天机器东谈主)这种类型的居品?文娱伴随型的 chatbot 是一种,ChatGPT 亦然一种 chatbot,这种类型的居品翌日还会是一个设施形态吗?照旧一个过渡形态,接下来要探索新的东西?

方汉: 我认为它仅仅一个原始形态。就像最早 QQ 刚出来的时候,全球都是用键盘打字输入到 QQ 对话框,然而到微信出来的时候,我姆妈从来不给我打字,都是平直发语音,以至一言分散就开视频。是以我认为当今的 chatbot 仅仅一个很早期的形态,像 GPT-4o 把多模态像语音、视频引入 chatbot,是天然的流程、安宁演进的。

就像早期的互联网有一个居品叫 MUD(Multi-User Dialogue,多用户对话),从笔墨 MUD(笔墨冒险游戏)又养殖出来了两个分量级的文娱游戏居品,一个是叫谎言西游,一个是叫魔兽天下。我认为当今的 chatbot 演化的终极形态有可能是一个近似于元天地的、杜撰多媒体的交互形态。

张鹏:可锐,你怎样看模子进展对 chatbot 这种形态的居品的影响?

闵可锐: 不同生态位的公司,受到的影响可能不一样。

一年以前,通盘这个词大模子业内比较贵重的样式是模子和愚弄一齐、产模一体衔接起来把居品恶果作念好的想路,这样才能斥地富足的壁垒。但 R1 其实对这种想路提议了很大的挑战。换句话说,后入局的玩家拿着可能相似好以至更好的模子,是不是也能平直把起跑线追平,驱动在上头作念愚弄?

贞洁从愚弄层角度来讲,当下这个阶段是相对利好的景况,因为拿到了一个富足好的兵器驱动作念同场竞技。

但 无论当今全球是看空照旧看多,可能两个月以后又会产生众多的回转, 是以我合计枪弹可能姑且得再飞片刻才有论断。

张鹏:变化太快,当今对于轨迹的瞻望不可高出两个月。当今看,原本那种产模一体的模式恐怕是必须的,也存在另外的可能性。吴翼从蚂合股团时刻研究院强化学习实验室的角度,你们接下来的主要方针和探索的东西是什么?

吴翼: 蚂合股团其实一直在作念我方的基座模子,也在作念推理模子,仅仅后者启动略略慢一些。咱们亦然客岁 11、 12 月份驱动,和一部分同学在蚂蚁研究院建立了强化学习实验室,驱动想作念我方的推理模子,中间也踩了许多坑。

基本上是研究院新设了这样一个强化学习实验室,也但愿能够在里面作念相对比较解放、比较通达的强化学习研究职责,作念出开源通达的推理模子,是以 DeepSeek 亦然给全球开了一个好头,饱读吹想去作念开源通达的时刻和模子团队。

06 开源能带来众多收益,不是作念公益

张鹏:自此次 DeepSeek-R1 开源轰动全球以后,全球许多公司在开源上作念了再行想考和礼聘。以至 Sam Altman 在答网友问时透露了 OpenAI 站在了历史演叨的一边,会再行想考 open 这件事。你合计 OpenAI 会再行回到开源模子吗?

吴翼: 我合计他不会。

张鹏:DeepSeek 的开源阶梯带来了哪些四百四病?为什么会有这些影响?

吴翼: DeepSeek 开源产生的影响,对我感触绝顶大。我合计临了最佳的阿谁模子应该照旧闭源,因为即使一个公司作念出了最佳的模子并开源,但在把它看成一个居品端去部署时,还可以作念更适配、更极致的优化,资本可以更低,因为他知谈这个模子是怎样作念的,是以一定会有一个里面适配、更好的版块。

然而即使这个开源模子会比闭源版块略略差一丝,但 DeepSeek 也照旧带来了众多的冲击。

传统全球礼聘开源的逻辑是:如果我是行业第一,我不开源;行业第二我也不开源;行业第三我一定要开源,因为不开源我就死了,同期我要开源让你们前两名不好过 (哈哈)。大模子最早的开源 credit(名誉)是 Meta 的 Llama,那时 Meta CEO 扎克伯格和首席 AI 科学家 Yann LeCun 讲,某种进程上,你们是站在咱们的肩膀上。然而如果仔细去想 Meta 全家桶本来的众多流量后,它其实莫得作念太多后续动作,它的通盘方针好像在说「我不可让把持发生」,我是老三,是以我一定要开源,让你们不好过,但他我方莫得因为这件事带来太多受益,或者仅仅股价上升了。

但 DeepSeek 开源不一样。这件事带来的最大的冲击是,以前从来莫得东谈主合计开源能带来绝顶好的生意模式,或者带来绝顶大的生意收益。当今全球在再行商酌这件事。

DeepSeek-R1 开源以来,当先 App 的 DAU 在十几天之内达到了几千万;同期,这件事情带来了众多的品牌效益,你会合计,原本作念开源不是为爱发电,即是为了「搞死」前两名;开源原本能带来这样紧要的收益。是以 在 AI 领域,如果你真的开源了一个相称好的模子,临了是有收益的。我嗅觉历史上从来莫得这样大范围的出现过这件事情。这件事情也会对通盘这个词社区、生态以及 AI 发展的速率带来平正,因为 AI 再次加快了。

这亦然为什么我还看好英伟达的原因,为了速率。英伟达的芯片能让你拿到这个(开源)模子之后,可能一个月就会迭代一版模子;但如果用国内的卡,迭代会慢比如半个月。之前我作念过一段时辰国产卡的熟谙,发现如果用英伟达的卡可能只花一个月,但如果给我国产卡,相似的事情可能要花 3 个月的时辰,或者说国产的算力我需要时辰作念适配。是以这是时辰的死别,你愿不肯意在一个 AI 高速发 展的期间里殉难你的时辰? 如果 AI 还在高速发展,那我合计英伟达就不可替代。然而如果一朝 AI 的速率放缓了,那就有问题。 是以我合计 DeepSeek 开源也带来了更高烈度的竞争,2025 年会是很刺激的一年,因为 AI 发展速率会更快。

张鹏:在 AI 领域,开源跟闭源可能会同期存在,尤其当下阶段,这件事是功德,站在东谈主类视角看,DeepSeek 开源反而是对通盘这个词通向 AGI 的发展,AI 在加快。

把它界说为 Sputnik Moment(1957 年,苏联得手辐射了东谈主类第一颗东谈主造卫星「斯普特尼克一号」,使得好意思国矍铄到我方在航天等要道时刻领域的过期,并纵容参预航天功绩)其实是冷战想维,比较稳健的类比是 Mozilla Moment(1998 年,网景公司将其浏览器网景 Communicator 源码开源,激勉了全球开发者的感情,鼓动了浏览器时刻的快速发展),从而加快AI平权,激勉了更多创新的力量。

07 DeepSeek 冲击波下,英伟达还好吗?

张鹏:R1,包括 V3 在保证模子恶果的情况下,杀青资本相对比较低。这是为什么?

吴翼: V3 暴露的 560 万好意思金是指它单次模子熟谙的资本,不包括前边研发等资本。把柄 V3 的资本,咱们大致测算 R1 资本依然很低,比 V3 资本再低一些。

但即是如果你合计,有 560 万好意思金就可以作念 R1 了,那你最佳先把这个数字前边乘个整个再来想这个事。

你要作念 R1,你先得作念 V3,之前还得作念 R1-Lite,R1-Lite 之前得先作念 V2,这些东西都用钱,不仅仅临了那一次得手了的资本。如果再商酌通盘这个词研发、实验可能会失败、治愈等全部资本,你需要乘一个整个。

天然 DeepSeek 合座比较高遵守,整个可能会小一丝,如果是大公司这个乘的整个可能会大一些。中枢是因为 DeepSeek 快。 相似的熟谙量和相似的数据,如果放在一个基建比较通俗的团队里,哪怕知谈怎样作念,可能也要再乘几倍的资本,因为熟谙得慢。DeepSeek 在以前很长一段时辰里面作念了相称相称多系统上的优化。不仅仅比如 MLA、MTP 就能握住的,而是可能有一系列很万古辰的工程优化累积起来,每天减少 5%、减少 10% 的时辰奢靡,这里一个优化、那处一个优化,把一个可能本来要 2000 万好意思金的熟谙,压到了临了是 560 万好意思金的散伙。

是以 这件事情是一个终年累积、很心疼基础设施的散伙, 有了这个基础,之后作念实验、作念新的模子也会更快,是一个相称相得益彰的流程。是以还得说 DeepSeek 长短常让东谈主敬佩的团队,在基础设施上也作念了许多许多职责。

方汉: 由于好意思国的禁运,咱们能够得到的算力资源是有限的。这样会倒逼通盘中国团队在软件优化上倾注媲好意思国同业更多的元气心灵。像 DeepSeek 团队作念的那样,比如杀青了 FP8 搀和精度的熟谙,压缩显存占用来让熟谙速率更快。在熟谙加快上,他们作念出了超卓的奋力,也获取了丰厚的呈文,这不是只在 R1 里才有体现,之前熟谙 V2 也照旧展现出这个实力。

张鹏:我再追问一下,DeepSeek-R1 出来之后,紧接着英伟达来了个连年来最大跌幅,有了更高遵守熟谙出来的模子,全球对英伟达的预期怎样样?

DeepSeek-R1 发布后,好意思国科技股大跌。|图片起原:视觉中国

方汉: 我的不雅点是, 对英伟达来说,短期利空、中期利好、永恒利空。

尽管 OpenAI 和软银的「星际之门」堪称要投资 400 亿好意思金,买的都是英伟达的熟谙卡,然而 DeepSeek 当今把熟谙资本打下去之后,好意思国东谈主也不可我方花 100 亿好意思金,来熟谙中国东谈主只消花 10 亿好意思金的任务。之前一齐高涨的股价,是因为通盘投资者都是赌他的熟谙卡,是以我合计短期利空英伟达。

中期利好是什么原因呢?如果仔细看 DeepSeek 的时刻求教,他们的通盘的推理优化都是基于英伟达的 CUDA 平台,比他们更懂英伟达 CUDA 平台的也莫得几家。一朝 DeepSeek 把绝顶好的模子的推理资本打下来之后,模子就更容易商品化,之后通盘这个词市集界限会变大。是以英伟达的推理卡在中期一定会卖得相称好。

永恒利空是当大模子驱动固化下来,英伟达推理卡的壁垒就保不住了,第三方厂商的契机就驱动来了。像好意思国有家叫 Groq 的公司,中国最近也少见十家芯片公司晓喻复旧 DeepSeek 模子部署。

张鹏:这件事是不是证明注解了,没那么多钱和卡也能创新?

闵可锐: 全球好像总把 DeepSeek 和它几百万好意思金的熟谙资本去作念关联,好像在界说,他们是钱和卡都很少的一个团队。 但其实,尤其在中国的范围来讲,DeepSeek 难谈不即是照旧是最有钱、最有卡的第一梯队的 player? 比起咱们可能这段时辰为了相接 R1 的用户量,到处去借了几百张卡来提供处事来讲,DeepSeek 其实照旧比咱们多了可能两个数目级以上的资源。

我合计资源在基座模子过甚居品上,仍然长短常迫切的。哪怕事实上你的模子熟谙遵守是 OpenAI 的 10 倍,然而你也莫得它 1/ 10 的资源,体现不出来你 10 倍遵守的擢升。因为绝大多数用户都是把柄居品体验用脚投票,不管你是用几许资源作念出来的这个散伙,我合计好用就用,不好用就无须。

其次我合计,基座模子层面的竞争是三个维度的空洞竞争散伙, 除了筹谋资源,还有你的东谈主才密度,以录取三个维度,可能亦然比较容易被淡漠的——1 号位在这件事上的能力和决心。 DeepSeek 在与国内第一梯队玩家接近的资源下,有中国最佳的东谈主才密度和 1 号位对这件事的贞洁的决心。

08 对于 DeepSeek,What』s Next?

张鹏:如果你是梁文峰,你合计 DeepSeek 接下来下一步的重点会是什么?

方汉: 我合计 DeepSeek 是一个相称轻生意化的公司,统统是靠时刻力破圈,而不是靠践诺破圈。许多东谈主情愿随着梁文峰总干的一个原因是因为他贞洁,到当今他还在手敲代码。我合计一个公司的 CEO 还在手敲代码的时候,这个公司一定是一个相称时刻向的公司。

他们的处事器扛不住这件事情,他信托会花心想去握住,然而至于流量能不可接得住?我个东谈主合计不是他温雅的重点。而且只消 DeepSeek 的时刻连续迭代,还会有泼天的流量,这也不是个问题。

当务之急信托照旧怎样样招更好的、志同谈合的东谈主进到他的团队,连续快速迭代,因为从 V2 出的 MLA、MTP,再到 R1 的 GRPO 出的 Dualpipe,你可以看到里面别出机杼的时刻更动百花齐放,证明他们是一支相称有构兵力的团队,东谈主才密度很高。只消他连续保持东谈主才密度,不盲目延长,还会连续在 AGI 的谈路上带来更多惊喜。

闵可锐: 对,我合计确乎是看 DeepSeek 作念这件事的初心。

作念 AGI 当先可能得不差钱,其次是一个偏执狂,如果想靠 AGI 来挣钱,多半会既挣不了钱也作念不好 AGI, 因为这个旅途其实并莫得那么看法,尤其是怎样靠 AGI 来挣钱这件事儿。

是以如果 DeepSeek 如果能守住初心,可能能够持续给全球带来惊喜。因为实质上,是两拨顶尖东谈主才比如 OpenAI 团队和 DeepSeek 团队的 PK。这个时候,犯错的容忍进程可能很低,凡是分神去商酌比如我是不是要作念一个最佳的 APP?一定会占用你的决议时辰和元气心灵。

图片起原:视觉中国

张鹏:你合计他接下来这个居品节律怎样样?到底会用多快的速率发哪个版块的什么?

吴翼: 如果站在这个时辰点, 当你有了一个 o1 的时刻之后,其实是有一个绝顶大的分叉点,是先去作念 o3 照旧去作念 agent?

这两件事情都挺重资源,然而从智能的角度看,是有 90 度夹角的。到底是沿着纯笔墨的推理走到极致,从 o1 追求到 o3?照旧去作念一个 agent,那它需要有视觉意会能力的闭环,作念出一些 action 后,还要有新的视频输入,要去作念一些 function call 写代码调接口的能力。

就像 OpenAI 最近发了一个 Operator 模子,是一个 agent 模子。agent 其实是强化学习 scaling world 的一个很迫切的分支,有了这套强化学习体系之后,你可以用强化学习的样式去熟谙一个多模态的模子,让它可以操作软件,操作手机,作念许多模态的截止,像一个真实的东谈主一样作念事,但从智能的角度上是莫得擢升的。智能照旧得奔着 o3 去,再作念 scale up。

两件事都很难,是以我会绝顶意思,DeepSeek 会怎样选?天然也可以都要。如果让我选,我会先追求 o3 极致的智能,因为作念了 o3 也可以再回头作念 agent。

方汉: 我认为 DeepSeek 接下来当先是泛化数据,当今的数据主若是编程跟数学,要把数据泛化到理科、文科,OpenAI 原本是雇数学博士,当今传说驱动雇生物博士去构造数据。我合计当今 DeepSeek 有了更好的资源也一定会在构造数据上作念出更多的探索。

第二,它也会泛化熟谙方法到多模态以及不同的领域。今天看到香港汉文大学的一篇论文,照旧有东谈主把 o1 的熟谙方法泛化到图像生成上了,是以我合计这两个场所应该都有很大的空间可以挖。

张鹏:某种进程上许多东谈主都看到所谓叫泼天的流量,但其实恐怕跟他站在相似的视角,他可能看到的是处事器压力很大,下一个模子还要再特等,更新的速率还要更快,开源的持续价值拜托……在这个天下翻开一扇门的时候,我要能够探索一个更大的天地,这里反而需要花更多的时辰聚焦在时刻上。怎样在不生意化的情况下把这事作念好,反而是更难的挑战。

*头图起原:视觉中国

极客一问

你怎样看待 Deepseek ?